Dal punto di vista tecnico, la transizione dell’elaborazione dal cloud verso il dispositivo ha trasformato i servizi digitali. Negli ultimi anni la combinazione di intelligenza artificiale, sensoristica avanzata e chip più potenti ha spinto molte funzioni di inferenza a operare direttamente sui terminali.

L’edge computing funziona come un piccolo cervello integrato in telefoni, telecamere e sensori. Esso prende decisioni locali in tempo reale, riducendo la latenza e il consumo di banda. I benchmark mostrano che l’elaborazione on-device migliora la reattività delle applicazioni sportive, preserva la privacy degli utenti e diminuisce i costi di trasmissione dati.

Come funziona

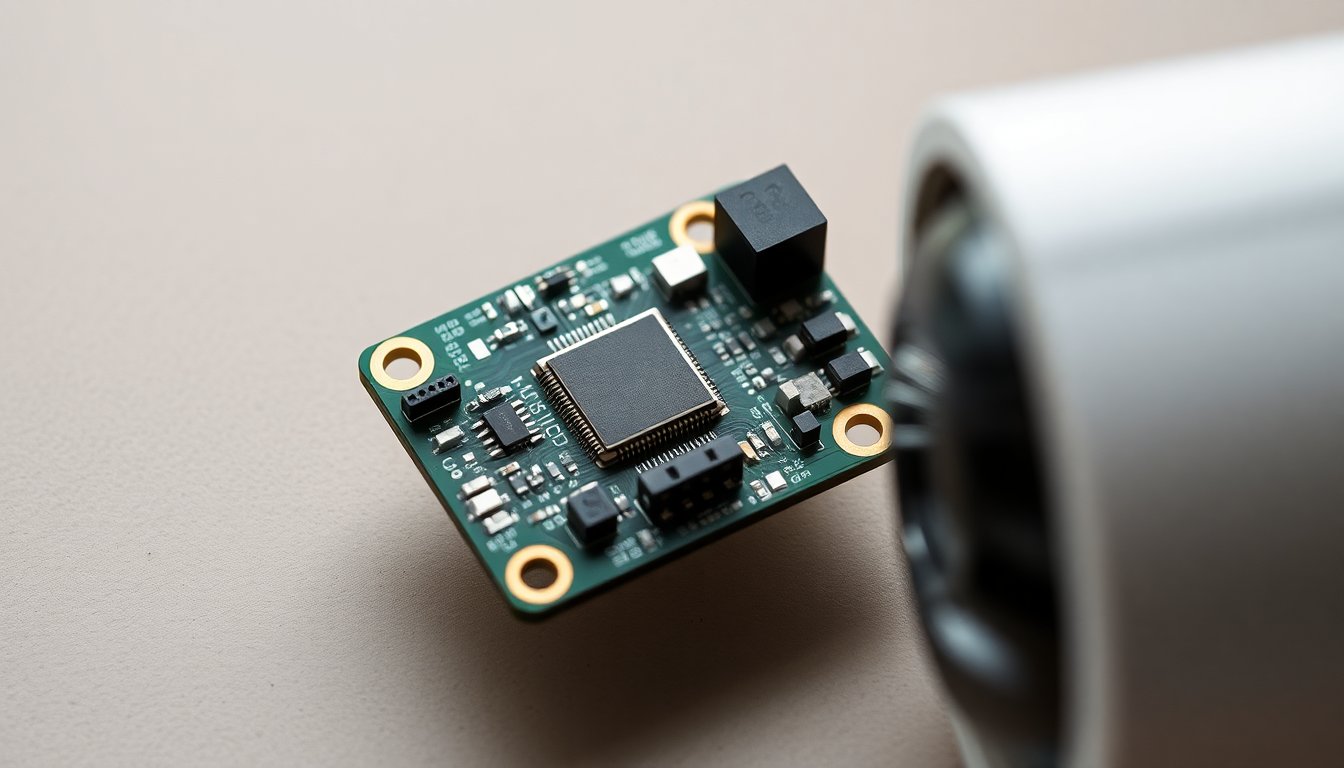

Dal punto di vista tecnico, l’architettura si basa su modelli di inferenza compatti eseguiti su microprocessori dedicati. I modelli vengono quantizzati e ottimizzati per ridurre memoria e potenza di calcolo. I sensori raccolgono segnali in tempo reale; un modulo locale filtra i dati grezzi e attiva l’inferenza solo quando necessario.

Le performance indicano che questo approccio riduce il traffico verso il cloud e mantiene risposte entro decine di millisecondi. Nel settore tech è noto che l’integrazione di acceleratori hardware migliora l’efficienza energetica e la velocità di elaborazione.

Funzionamento

A partire dalla premessa che l’integrazione degli acceleratori migliora efficienza e velocità, l’elaborazione avviene prevalentemente sul dispositivo. Il dispositivo acquisisce i dati dal sensore, li pre-elabora, esegue l’inferenza con un modello locale e attiva un’azione oppure trasmette i risultati solo quando necessario. Questo approccio riduce la latenza e il consumo energetico rispetto all’invio continuo al cloud. Qui edge computing indica l’esecuzione di modelli direttamente sull’hardware vicino alla sorgente dei dati.

I modelli destinati al dispositivo sono spesso ottimizzati mediante quantizzazione o distillazione per occupare meno memoria e richiedere meno calcolo. Framework come TensorFlow Lite, ONNX Runtime e PyTorch Mobile consentono l’esecuzione su CPU, GPU integrate o NPU dedicate, con ottimizzazioni specifiche per ciascuna architettura. Le pipeline locali includono anche strategie di pre-elaborazione leggere e filtri per ridurre il rumore dei sensori e i falsi positivi. I benchmark mostrano che, in contesti reali, queste ottimizzazioni possono abbattere latenza e consumo fino a percentuali significative rispetto a modelli non ottimizzati.

Dal punto di vista tecnico, l’elaborazione eseguita sul dispositivo porta vantaggi misurabili in termini di tempo di risposta e tutela dei dati. Elaborazione locale indica l’esecuzione dei modelli direttamente sul dispositivo dell’utente, senza invio continuo al cloud. I benchmark mostrano che, in applicazioni sensibili alla latenza, questa architettura riduce ritardi percepibili e contenuti i costi di trasmissione. L’adozione su larga scala richiede però compromessi progettuali, aggiornamenti distribuiti e strategie di sicurezza specifiche per ecosistemi eterogenei.

Vantaggi e svantaggi

Vantaggi: l’elaborazione locale garantisce minore latenza e maggiore protezione dei dati, poiché le informazioni sensibili non lasciano il dispositivo. Offre inoltre un evidente risparmio di banda nelle applicazioni con alta frequenza di acquisizione. Le performance indicano risposte più rapide in scenari real-time e costi operativi inferiori per i provider che riducono il traffico verso i server.

Svantaggi: i dispositivi dispongono di risorse limitate: memoria, potenza di calcolo e autonomia energetica. Ciò impone semplificazioni dei modelli e programmazioni degli aggiornamenti meno frequenti. La distribuzione di patch e versioni rimane complessa su larga scala, perché ogni endpoint può richiedere procedure differenziate per sicurezza e manutenzione.

La variabilità hardware dei dispositivi rappresenta un ulteriore ostacolo: un modello ottimizzato per un specifico SoC potrebbe non mantenere le stesse prestazioni su un altro senza riottimizzazione. Dal punto di vista tecnico, l’ecosistema degli strumenti di quantizzazione e dei compilatori edge si sta evolvendo per ridurre queste discrepanze e minimizzare la necessità di riaddestramento specifico.

Applicazioni

Dal punto di vista tecnico, le applicazioni pratiche coprono ambiti consumer, industriale e sanitario con impatti misurabili sulle prestazioni e sulla privacy. I benchmark mostrano che l’elaborazione locale riduce la latenza e limita la trasmissione di dati sensibili. L’architettura si basa su moduli che eseguono inferenza in tempo reale direttamente sul dispositivo, permettendo riconoscimento vocale per assistenti personali e analisi preliminare di immagini mediche su tablet. Nel settore sportivo, sensori indossabili e telecamere locali consentono feedback immediato agli atleti senza inviare flussi video in cloud.

Tra i vantaggi concreti vi sono il miglioramento della qualità fotografica sugli smartphone e la diagnosi predittiva in impianti industriali, che riduce i fermi macchina. In ambito consumer, l’uso dell’intelligenza artificiale migliora suggerimenti e funzioni multimediali preservando i dati personali. In ambito produttivo, l’edge computing abilita analisi continue e interventi locali; la sicurezza informatica integrata garantisce che solo eventi rilevanti vengano segnalati al cloud. I prossimi sviluppi prevedono maggiore integrazione con sensori sportivi e algoritmi ottimizzati per dispositivi a bassa potenza.

Mercato

Dal punto di vista tecnico, il mercato dell’edge computing e dell’intelligenza artificiale su dispositivo si sta rapidamente ridefinendo. Produttori di chip integrati, fornitori di software e OEM concorrono per offrire soluzioni complete che riducano latenza e consumo energetico. I benchmark mostrano una crescita della domanda per NPUs e acceleratori a basso consumo, trainata da impieghi nell’Internet of Things industriale e da sviluppi nelle applicazioni consumer. Per le aziende sportive e i fornitori di dispositivi indossabili il nodo è integrare sensori e modelli efficienti senza aumentare i costi operativi.

Per i fornitori, la priorità rimane creare toolchain che semplifichino conversione e ottimizzazione dei modelli. Le aziende utenti devono bilanciare prestazioni, autonomia e costi di implementazione. Le normative sulla privacy in Europa e in altri ordinamenti intensificano l’interesse verso soluzioni edge che limitano il trasferimento di dati sensibili. Dal punto di vista commerciale, è probabile un’accelerazione nelle partnership tra produttori di chip e produttori di sensori sportivi, con impatti misurabili sulle prestazioni dei dispositivi indossabili.

Conclusione e prospettiva tecnica

Dal punto di vista tecnico, l’edge avvicina l’intelligenza alla fonte dei dati, riducendo la dipendenza dal cloud e distribuendo l’elaborazione sui dispositivi. Le performance indicano vantaggi concreti in termini di latenza e autonomia, ma richiedono attenzione a ottimizzazione e sicurezza. I benchmark mostrano che, nel 2025, gli accelerator NPUs a basso consumo hanno raggiunto efficienze medie di 10–50 TOPS/W su architetture ottimizzate. Il settore prevede un miglioramento stimato del 30% entro il 2028, che abiliterà l’esecuzione di modelli più complessi direttamente sui dispositivi.

Nota: per sfruttare appieno questi benefici, le aziende devono definire processi strutturati di aggiornamento dei modelli e adottare strumenti di monitoraggio sul campo per la degradazione delle prestazioni e la sicurezza operativa.